ТОР 5 статей:

Методические подходы к анализу финансового состояния предприятия

Проблема периодизации русской литературы ХХ века. Краткая характеристика второй половины ХХ века

Характеристика шлифовальных кругов и ее маркировка

Служебные части речи. Предлог. Союз. Частицы

КАТЕГОРИИ:

- Археология

- Архитектура

- Астрономия

- Аудит

- Биология

- Ботаника

- Бухгалтерский учёт

- Войное дело

- Генетика

- География

- Геология

- Дизайн

- Искусство

- История

- Кино

- Кулинария

- Культура

- Литература

- Математика

- Медицина

- Металлургия

- Мифология

- Музыка

- Психология

- Религия

- Спорт

- Строительство

- Техника

- Транспорт

- Туризм

- Усадьба

- Физика

- Фотография

- Химия

- Экология

- Электричество

- Электроника

- Энергетика

Основные свойства и характеристики информации

Для того чтобы иметь возможность использовать понятие информации при решении различных инженерно-психологических задач, нужно знать основные характеристики и свойства информации. Основными ее характеристиками являются количество, ценность, избыточность и достоверность. Количество информации является важнейшей характеристикой информации, используемой в инженерной психологии. Простой формальный аппарат для оценки количества информации, содержащейся в сообщении, разработан в классической теории информации (статистической теории связи).

При таком подходе количество информации определяется величиной уменьшения энтропии (неопределенности ситуации) после получения человеком каких-либо сведений. Величина энтропии рассчитывается по формуле

(2.2)

(2.2)

где Pi — вероятность i-того сигнала (нахождения системы в i-том состоянии);

п — общее число различных сигналов (состояний системы).

В случае, если все сигналы равновероятны (Pi  ), то энтропия при данном n достигает своего максимального значения, равного

), то энтропия при данном n достигает своего максимального значения, равного

H = log2 n, (2.3)

При поступлении сообщения о каком-либо событии энтропия системы уменьшается, причем это уменьшение и характеризует количество поступившей информации

I = Н—Н0, (2.4)

где Н и Н0 — соответственно априорная (доопытная) и апостериорная (послеопытная, т. е. после получения сообщения) энтропия.

В том практически важном случае, когда после поступления сведений состояние системы стало полностью определенным (а именно такой случай наиболее характерен для деятельности оператора), то количество информации численно равно априорной энтропии системы, т. е. I = Н.

В формулах (2.2) и (2.3) логарифм может браться по любому основанию, но наиболее часто используется основание, равное двум. При этом единица измерения количества информации носит название двоичной единицы информации (деи), или бита. Информация в один бит будет иметь место в том случае, когда осуществляется выбор одного из двух равновероятных событий. Передача информации, равной одному биту позволяет уменьшить неопределенность ситуации вдвое.

Количество информации, перерабатываемое оператором в единицу времени, называется скоростью переработки информации оператором, то есть VОП  . Наибольшая скорость переработки информации человеком, рассматриваемом в качестве канала связи, т. е. канала передачи информации со средств ее отображения к органам управления, называется пропускной способностью оператора. Ее величина в общем случае определяется формулой

. Наибольшая скорость переработки информации человеком, рассматриваемом в качестве канала связи, т. е. канала передачи информации со средств ее отображения к органам управления, называется пропускной способностью оператора. Ее величина в общем случае определяется формулой

(2.5)

(2.5)

где Н(х) — энтропия источника сообщений; Ну(х) — условная энтропия, характеризующая влияние шумов (помех) на передачу сообщений, она характеризует потери информации в процессе ее передачи; t — время передачи информации.

Любой канал связи, в том числе и систему переработки и передачи информации оператором, можно представить в виде нескольких последовательных участков передачи информации. Очевидно, пропускная способность канала в целом будет определяться пропускной способностью того участка, для которого она минимальна. Подробнее этот вопрос рассматривается при изучении информационных характеристик зрительного анализатора.

Количество информации характеризует объем полученных человеком сведений, оно совершенно не зависит от свойств получателя сообщений и характеризует только одну сторону информации — структурную, статистическую. Однако кроме нее есть и прагматическая сторона, которая всегда связана с целью деятельности человека и поэтому зависит от его индивидуальных качеств. Эта сторона информации характеризуется таким понятием как ценность информации. Знание ценности информации позволяет рационально размещать датчики и измерительные приборы на рабочем месте оператора, сокращать общий объем информационного потока, разумно планировать очередность передачи сообщений оператору, назначая приоритеты согласно ценности, и т. п.

Ценность информации характеризует значение информации для получателя. Для ее количественной оценки разработано три основных подхода [цит. по 46, 77].

1. Ценность информации определяется по тому, насколько получаемое сообщение способствует достижению цели. Количественно показатель ценности определяется формулой

(2.6)

(2.6)

где Р0 и P1 и — соответственно вероятность достижения цели до и после получения сообщения.

При таком подходе ценность информации, также как и ее количество, выражается в двоичных единицах (А.А.Харкевич).

2. Понятие ценности информации выводится из связи теории информации с теорией оптимального управления. Для этого рассматривается система случайных величин х и система их оценки у. Средняя степень неопределенности существующих оценок определяется функцией штрафов f(x, у). Ценность же полученной информации находится по тому, насколько эта информация минимизирует функцию штрафов, т. е. делает оценки более определенными (Р.Л. Стратонович).

3. Ценность информации определяется исходя из того, насколько она снижает степень неопределенности (трудности) решаемой задачи. Если задача с п равновероятными исходами имеет начальную неопределенность HQ = log2 n, а после поступления сообщения q относительно вероятности ответов Р ее неопределенность стала, то ценность информации равна H=  ,

,

(2.7)

(2.7)

При таком подходе ценность информации определяется уже не по ее влиянию на статистическую неопределенность отдельных сообщений, а по тому, в какой мере она снимает неопределенность самого метода решения. Здесь может учитываться и ложная информация, повышающая неопределенность задачи (М.М. Бонград).

Рассмотренные методы определяют ценность информации для человека исходя из ее значения для него. Осознание ценности информации человеком будет вызывать у него соответствующие эмоции. Поэтому приведенные показатели могут служить также косвенными мерами уровня эмоциональной реакции человека на информацию.

Как уже отмечалось, наличие ложной информации снижает ее общую ценность. Поэтому важной характеристикой информации является ее достоверность» Под достоверностью информации понимается безошибочная (не искаженная) передача, переработка и хранение информации в системе при заданных условиях ее эксплуатации [214]. Качественно достоверность информации определяется как ее свойство на выходе системы соответствовать информации, поступившей на ее вход. Количественно достоверность информации оценивается такими показателями, как наработка на информационную ошибку, интенсивность информационных ошибок, вероятность безошибочности информации.

При расчетах этих показателях принимаются следующие допущения:

■ информационные ошибки (искажения) в составных компонентах системы — события независимые, случайные;

■ поток информационных ошибок является простейшим;

■ появление информационный ошибки (искажения) в отдельной компоненте системы приводит к появлению ошибки на выходе системы;

■ критерии появления (наличия) ошибок точно определены и их можно использовать для диагностики ошибок.

С учетом этих допущений в работе [214] предложены формулы для определения показателей достоверности информации. Наработка на информационную ошибку рассчитывается по формуле

(2.8)

(2.8)

где N∑ — суммарная информационная наработка системы в единицах обрабатываемой информации, элементах (суммарная информационная нагрузка системы);

Nош — число возникших ошибок в системе (искаженных элементов информации) в рассматриваемой суммарной информационной нагрузке.

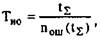

В некоторых случаях рассматривают также временную наработку системы (с определенным быстродействием) на информационную ошибку

где t∑ и n(t∑) — соответственно суммарное время наработки и возникшее за это время число информационных ошибок.

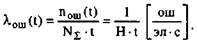

Под интенсивностью ошибок (искажений) понимается отношение числа ошибок nош (t), возникших за некоторый интервал времени t, к произведению информационной нагрузки за этот же интервал на его длительность, то есть

(2.9)

(2.9)

Вероятностью безошибочности (не искаженности) информации называется вероятность того, что в определенных условиях работы в пределах заданной информационной нагрузки (заданной продолжительности) ошибка (искажение) в информации не появится. Эта вероятность по статистическим данным находится по формуле

(2.10)

(2.10)

Основным методом повышения достоверности информации в информационных системах (как технических, так и в системе переработки информации человеком) является применение помехоустойчивых кодов [14, 91]. Применение помехоустойчивых кодов связано с введением избыточности в исходную информацию.

Избыточность информации есть некоторая величина r, которой измеряется относительная доля излишне используемых сообщений в некотором алфавите. Она определяется формулой

(2.11)

(2.11)

где Н — энтропщия сообщения, п — средняя длина кодового слова, М — число символов алфавита.

Естественным языкам свойственна значительная избыточность информации (например, для русского языка r = 0,5...0,8). Избыточность информации может быть естественной (например, естественные языки, изображения и т. п.) и искусственной. Последняя специально вводится для улучшения помехоустойчивости, достоверности и надежности передачи и хранения информации [166]. В общем случае избыточность информации оказывает двоякое влияние на характеристики информационных систем, в том числе и на процессы переработки информации человеком.

С одной стороны, избыточность информации существенно повышает ее помехоустойчивость, дает возможность восстановить искаженную информацию. Например, искажение или потеря отдельных букв, слов, а иногда и фраз позволяет правильно распознать смысл письменного или устного сообщения; искажение одного, двух сегментов знакосинтезирующих цифровых индикаторов позволяет в ряде случаев восстановить истинное значение отображаемой цифры и т. д. Примером избыточности в информационных структурах мозга является парность некоторых анализаторов (зрительного, слухового), что повышает надежность их работы. Избыточную информацию не следует путать с иррелевантной, которая является помехой и мешает нормальной работе оператора. Существует три основных способа введения избыточности: многократное повторение одной и той же информации; введение в сигналы дополнительных элементов; метод избыточных переменных.

С другой стороны, избыточность усложняет систему, увеличивает время обработки информации, снижает реальную пропускную способность каналов связи. Поэтому определение необходимой избыточности решается в каждом конкретном случае исходя из особенностей решаемой задачи и возможных ограничений. В случае необходимости для уменьшения избыточности применяют методы, разработанные в теории оптимального кодирования, а также специальные методы сжатия информации.

Сжатием информации (сжатием данных) называется представление информации (данных) меньшим числом битов по сравнению с первоначальным. Различают сжатие информации без потери информации и с потерей некоторой ее части, несущественной для решаемых задач. К первой группе относятся методы кодирования, использующие статистику потока сигналов для получения выигрыша в среднем, например, кодирование короткими комбинациями символов более часто встречающихся элементов сообщения (код Морзе), Ко второй группе относятся методы, основанные на различных аппроксимациях данных, например, кодирование непрерывной кривой дискретными отсчетами, основанное на теории Шеннона — Котельникова.

По способу устранения избыточности все методы сжатия информации делятся на три группы: 1) структурные, предусматривающие дискретное строение массивов информации и предполагающее их простейшее кодирование; 2) статистические, определяемые понятием энтропии как меры неопределенности, учитывающий вероятности появления, а следовательно, и информативности тех или иных сообщений (см. выше); 3) семантические, учитывающие целесообразность, ценность, полезность или существенность информации.

При инженерно-психологическом проектировании для уменьшения времени и вероятности ошибочных действий оператора при вводе и считывании информации сжатие является основным методом создания компактных систем ввода и систем отображения информации, поскольку возможности их пространственного уплотнения ограничены психофизиологическими особенностями оператора. Для этого используется все рассмотренные методы исключения избыточности, обеспечивающие минимизацию числа кнопок их размещение на панели управления с учетом структуры системы управления, числа команд и частоты обращения к кнопкам пульта. Аналогичное делается для создания компактных систем отображения информации вызывного типа с учетом возможного числа сигналов, вероятности их поступления, а также важности и срочности их обработки.

Информация, циркулирующая в системе «человек—машина» может обладать такими нежелательными свойствами, как старение и рассеяние, что в случае их неучета приводит к снижению эффективности процесса управления.

Старение информации связано с конечным временем ее передачи и обработки. Наиболее часто задержки на пути информации от источника до получателя происходят в различного рода накопителях (запоминающих устройствах) и каналах связи. Нередко задержку вводят искусственно с целью получить взамен меньшую вероятность ошибки. Примером является многократное повторение одной и той же информации  (временная избыточность). Однако чаще всего старение информации возникает естественным путем.

(временная избыточность). Однако чаще всего старение информации возникает естественным путем.

Если информация носит оперативный характер и используется для принятия решений или выработки управляющих воздействий, то за время задержки она стареет. В результате управление либо принятое решение могут оказаться не эффективным. Для устранения этого оператор должен экстраполировать полученную информацию на некоторое время вперед, то есть осуществлять прогнозирование изменения информации во времени. От точности прогноза и будет зависеть эффективность управления.

К настоящему времени разработаны следующие алгоритмы прогноза: прогноз по последнему значению, прогноз по математическому ожиданию, статистический прогноз по одной точке. Каждый из них имеет свои преимущества и недостатки [46], само прогнозирование может осуществляться либо автоматически (тогда в систему обработки и передачи информации дополнительно вводится специальное устройство — экстраполятор), либо оператором. В этом случае он должен быть специально обучен навыкам экстраполяции. Особое значение при этом имеет способность оператора к антиципации (от лат. anticipatio — предвосхищаю), т. е. способности предвидеть будущие, предстоящие события. Поскольку изменение ситуации за время прогноза зачастую представляет собой случайный процесс, то оператор должен уметь осуществлять вероятностное прогнозирование. Все это позволит ему более рационально (разумеется, в определенных пределах) использовать стареющую информацию.

Зная количественные оценки стареющей информации, можно вовремя очищать запоминающие устройства от устаревших данных, назначать сроки принятия решений так, чтобы они базировались на достоверных, не устаревших сведениях, назначать из тех же соображений допустимое время передачи информации и т. п. [46].

В практике экспериментирования и контроля хода технологических процессов обычной является ситуация, когда о значениях какого-либо параметра судят по результатам других величин, связанных с ним. Такой метод называется косвенными измерениями. При этом информация может оказаться рассеянной среди данных о других величинах. Помимо этого часто возникает ситуация, когда оператору для решения текущей задачи приходится использовать информацию, поступающую от различных, отстоящих друг от друга источников. Рассмотренные ситуации роднит то обстоятельство, что в них имеет место рассеяние информации.

Различают два основных вида рассеяния. Во-первых, рассеяние по ансамблю источников, когда нужная для решения задачи информация находится в разных местах информационного поля. Во-вторых, — это рассеяние по времени, когда информацию о каком-либо факте несут не только текущие события либо значения наблюдаемых процессов, но и отстоящие от них на некоторое время. В этом случае для решения задачи одновременно нужно использовать сведения, относящиеся к различным моментам времени.

Следовательно, в общем случае нужная для решения задачи информация может оказаться рассеянной как среди других источников, так и относится к разным временным интервалам. Оказывается, что специальная обработка позволяет собрать такие данные, сконцентрировать их. Перспективными путями концентрации рассеянной информации являются, с одной стороны, запоминающие устройства действующие на ассоциативном принципе, а с другой — диалоговые системы общения человека с ЭВМ, обеспечивающие итеративное повышение уровня взаимопонимания [46]. Концентрации информации способствует также применение компактных устройств ввода и отображения информации, рациональная компоновка рабочего места оператора, упорядоченное размещение элементов и их логическая группировка, своевременная подсказка оператору о необходимых действиях и т. п.

Не нашли, что искали? Воспользуйтесь поиском: