ТОР 5 статей:

Методические подходы к анализу финансового состояния предприятия

Проблема периодизации русской литературы ХХ века. Краткая характеристика второй половины ХХ века

Характеристика шлифовальных кругов и ее маркировка

Служебные части речи. Предлог. Союз. Частицы

КАТЕГОРИИ:

- Археология

- Архитектура

- Астрономия

- Аудит

- Биология

- Ботаника

- Бухгалтерский учёт

- Войное дело

- Генетика

- География

- Геология

- Дизайн

- Искусство

- История

- Кино

- Кулинария

- Культура

- Литература

- Математика

- Медицина

- Металлургия

- Мифология

- Музыка

- Психология

- Религия

- Спорт

- Строительство

- Техника

- Транспорт

- Туризм

- Усадьба

- Физика

- Фотография

- Химия

- Экология

- Электричество

- Электроника

- Энергетика

Эволюция представлений об энтропии

Проникновение методов теории информации в физику, биологию и другие области естествознания показало тесную взаимосвязь понятия количества информации с естественно-научным понятием "энтропия".

Понятие энтропии, первоначально введенное Р. Клаузиусом (в XIX в.) лишь с целью более удобного описания работы тепловых двигателей, усилиями многих ученых, и прежде всего Л. Больцмана, стало играть универсальную роль, определяя многие закономерности в поведении макроскопических систем. В 30-х годах нашего столетия энтропия стала мерой вероятности информационных систем и явилась основой теории информации (работы Л. Сцилларда, К. Шеннона).

Связь между энтропией и вероятностью установлена Л. Больцманом и выражается знаменитой формулой, носящей имя этого ученого:

Н = a ln W,

где H - энтропия; W - термодинамическая вероятность состояния.

Существенно, что Больцман, связав второй принцип термодинамики с теорией вероятности, показал, что убывание энтропии не является невозможным, а только маловероятным. Второй принцип термодинамики становится констатацией того факта, что информация теряется различными способами, что ведет к увеличению энтропии системы, но, чтобы приобрести новую информацию и уменьшить энтропию, следует произвести новые измерения, т.е. затратить энергию.

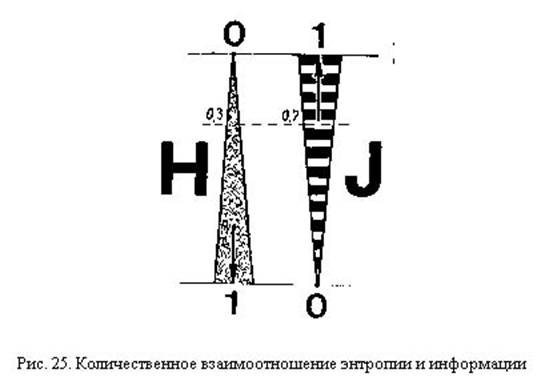

На рубеже второй половины XX в. работами Э. Шредингера понятие энтропии еще более расширилось - до понимания ее как меры дезорганизации систем любой природы (рис. 24). Эта мера простирается от максимальной энтропии (H = 1), т.е. хаоса, полной неопределенности, до исчезновения энтропии (Н = 0), соответствующего наивысшему уровню организации, порядка.

С помощью энтропии стало возможно количественно оценивать такие на первый взгляд качественные понятия, как "хаос" и "порядок". Информация и энтропия связаны потому, что они характеризуют реальную действительность с точки зрения именно упорядоченности и хаоса, причем если информация - мера упорядоченности, то энтропия - мера беспорядка; одно равно другому, взятому с обратным знаком. Например, если на предприятии низка трудовая и технологическая дисциплина, идет брак, то мы можем утверждать, что здесь низок уровень организации, или велика энтропия. Она угрожающе растет ныне и в нашей экономике, социальной жизни.

Энтропия и информация служат, таким образом, выражением двух противоположных тенденций в процессах развития. Альтернативность и взаимосвязь понятий энтропии и информации нашли отражение в формуле H + J = 1 (const) и на рис. 25. Если система эволюционирует в направлении упорядоченности, то ее энтропия уменьшается. Но это требует целенаправленных усилий, внесения информации, т.е. управления. "Мы плывем вверх по течению, борясь с огромным потоком дезорганизованности, которая в соответствии со II законом термодинамики стремится все свести к тепловой смерти - всеобщему равновесию и одинаковости, т.е. энтропии, - пишет Н. Винер. - В мире, где энтропия в целом стремится к возрастанию, существуют местные вр е менные островки уменьшающейся энтропии, это области прогресса". Механизм их возникновения состоит в естественном или целенаправленном отборе устойчивых форм. Человек всю жизнь борется с энтропией, гася ее извлечением из окружающей среды отрицательной энтропии - информации [11].

Количество информации, отождествляемое Винером с отрицательной энтропией (негэнтропией), становится, подобно количеству вещества или энергии, одной из фундаментальных характеристик явлений природы. Введение понятия энтропии в теорию информации явилось, по выражению Луи де Бройля, "наиболее важной и красивой из идей, высказанных кибернетикой", и рассматривается как большой вклад в научную мысль [12]. Это положение называют еще вторым "краеугольным камнем" кибернетики. Отсюда - толкование кибернетики как теории организации, теории борьбы с мировым хаосом, с роковым возрастанием энтропии. Такое понимание энтропии должно найти отражение и в современной концепции спирали развития, как мысленной модели процессов самоорганизации.

Не нашли, что искали? Воспользуйтесь поиском: